Pourquoi les charges de travail Teradata deviennent instables - et comment les équipes le détectent tôt

24 avr. 2026

|

6

minute de lecture

Les systèmes Teradata sont conçus pour la stabilité. Depuis des décennies, les entreprises s’appuient sur Teradata pour fournir à grande échelle des analyses prévisibles et hautement performantes. Dans des secteurs réglementés tels que la banque, l’assurance, les télécoms et le secteur public, Teradata reste un socle critique pour la prise de décision.

Pourtant, même dans ces environnements matures, les équipes données rencontrent un problème familier : les charges de travail autrefois stables deviennent progressivement imprévisibles.

La consommation CPU fluctue. L’utilisation des E/S dérive à la hausse. Les traitements de longue durée consomment davantage de ressources mois après mois. Les coûts augmentent, non pas parce que quelque chose est cassé, mais parce que quelque chose a discrètement changé.

Comprendre pourquoi les charges de travail Teradata deviennent instables, et comment détecter cette instabilité tôt, est essentiel pour maintenir les performances, l’efficacité des coûts et la confiance opérationnelle.

L’instabilité dans Teradata apparaît rarement du jour au lendemain

Contrairement aux plateformes cloud modernes, les environnements Teradata ont tendance à évoluer lentement. Les changements sont délibérés, contrôlés et bien documentés. Par conséquent, l’instabilité se manifeste rarement par une panne soudaine.

Elle apparaît plutôt sous forme de dérive comportementale:

Les traitements se terminent toujours avec succès

Les SLA sont techniquement respectés

Les tableaux de bord n’affichent aucun signal d’alerte évident

Pourtant, sous la surface, le comportement des charges de travail change. L’utilisation CPU augmente légèrement. Les schémas d’E/S deviennent plus erratiques. Les fenêtres de traitement se resserrent. Au fil du temps, ces petites déviations s’accumulent et créent un risque opérationnel.

Au moment où l’instabilité devient visible, la correction est souvent coûteuse et perturbatrice.

Causes courantes de l’instabilité des charges de travail Teradata

1. Une croissance des données qui modifie les plans d’exécution

La croissance des données est inévitable, mais son impact est rarement linéaire.

À mesure que les tables grossissent :

Les stratégies de jointure changent

L’utilisation du spool augmente

Les coûts de redistribution augmentent

La répartition de la charge entre les AMP se modifie2

Les requêtes autrefois efficaces commencent à consommer davantage de CPU et d’IO, même si le SQL lui-même n’a pas changé. Comme la croissance est progressive, les alertes traditionnelles basées sur des seuils ne se déclenchent que rarement assez tôt.

2. Une logique SQL qui évolue lentement

Les charges de travail Teradata ne sont pas statiques.

Au fil du temps :

Des jointures supplémentaires sont introduites

De nouveaux attributs sont sélectionnés

Les filtres sont assouplis

Les besoins en matière de reporting s’élargissent

Chaque ajustement paraît mineur, mais, cumulativement, ils modifient les caractéristiques des charges de travail. Les traitements durent plus longtemps, consomment davantage de ressources et deviennent moins prévisibles.

Sans analyse historique, ces changements ne sont souvent découverts qu’après des plaintes d’utilisateurs ou une hausse des coûts.

3. Déséquilibre et changements de distribution

Le déséquilibre des données est un défi bien connu dans de nombreux systèmes MPP comme Teradata.

Le déséquilibre peut apparaître en raison de :

Des migrations de données

Des évolutions démographiques

Une croissance de l’activité concentrée dans des segments spécifiques

Des changements dans les hypothèses de modélisation des données

À mesure que le déséquilibre augmente, la distribution des charges de travail entre les AMP devient inégale. Certains AMP consomment une part disproportionnée du CPU et des E/S, ce qui dégrade les performances globales du système.

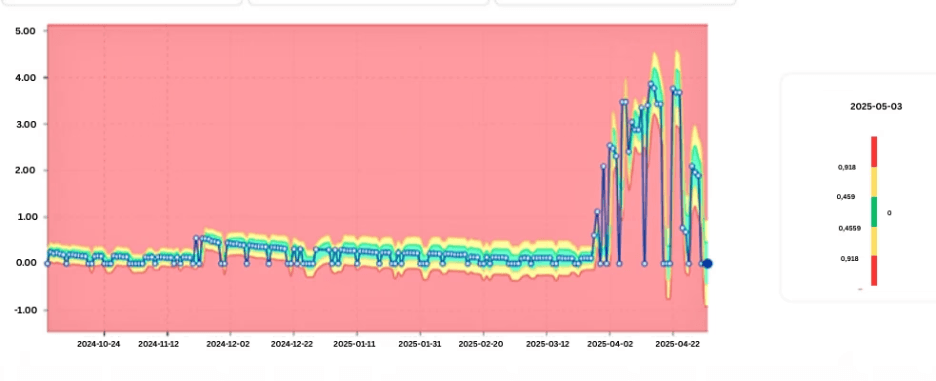

Visualisation des données montrant l’augmentation du déséquilibre CPU au niveau des AMP au fil du temps.

4. Ajustements de l’infrastructure et de la configuration

Même les systèmes Teradata bien gérés évoluent.

Des changements tels que :

Des mises à niveau matérielles

Une reconfiguration de la plateforme

Des réglages système

Une priorisation des charges de travail mixtes

peuvent influencer subtilement le comportement des charges de travail. Un traitement qui s’exécutait de manière constante pendant des années peut soudainement montrer une variabilité accrue — non pas à cause de problèmes de données, mais parce que l’environnement d’exécution a changé.

5. Traitements cycliques et saisonniers

De nombreuses charges de travail Teradata suivent des cycles prévisibles :

Clôture de fin de mois

Rapports réglementaires

Rapprochements périodiques

Sans modéliser explicitement la saisonnalité, un comportement cyclique normal peut masquer de véritables anomalies ou générer des alertes inutiles.

Distinguer la variation attendue d’une réelle instabilité nécessite un contexte historique.

Pourquoi la surveillance traditionnelle de Teradata manque les premiers signaux

Les environnements Teradata sont généralement surveillés à l’aide de :

Alertes CPU et E/S basées sur des seuils

Limites de temps d’exécution des requêtes

Tableaux de bord d’utilisation du système

Ces outils sont efficaces pour identifier les pannes aiguës, mais ils peinent face au changement progressif.

Ils répondent à des questions telles que :

Le CPU a-t-il dépassé une limite ?

Un traitement a-t-il échoué ?

Ils ne répondent pas à :

Ce traitement devient-il plus coûteux au fil du temps ?

Son comportement devient-il moins stable ?

La charge de travail d’aujourd’hui est-elle plausible par rapport aux schémas historiques ?

L’instabilité se trouve dans ces questions sans réponse.

Le rôle de l’analyse de séries temporelles dans les opérations Teradata

La détection précoce exige de traiter les métriques de charge de travail comme des signaux de séries temporelles, et non comme des valeurs statiques.

Les principales métriques Teradata incluent :

Temps CPU

Nombre d’E/S

Utilisation du spool

Temps d’exécution des requêtes

Croissance des tables

Analysées dans le temps, ces métriques révèlent :

Des tendances à long terme

Une volatilité croissante

Des changements structurels à la suite de déploiements ou de migrations

Des écarts par rapport aux normes saisonnières

Cette perspective fait passer la surveillance des charges de travail du dépannage réactif au contrôle proactif.

Détecter l’instabilité avant qu’elle ne devienne un problème

Apprendre le comportement normal des charges de travail

Au lieu de définir des seuils statiques, les approches modernes observent le comportement historique des charges de travail et apprennent à quoi ressemble le « normal » pour chaque traitement, classe de requête ou composant du système.

À mesure que les schémas se stabilisent, les plages acceptables deviennent plus claires. Les écarts par rapport à ces schémas appris signalent des problèmes potentiels, même si les valeurs absolues restent dans des limites nominales.

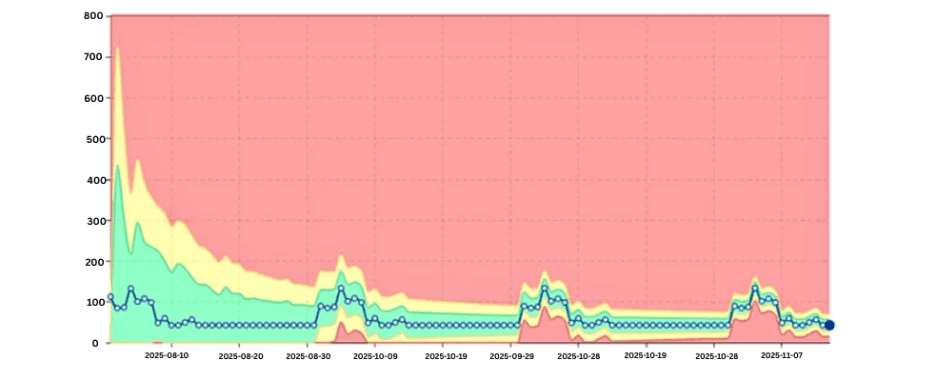

Graphique montrant des bandes de comportement normal apprises avec une dérive émergente.

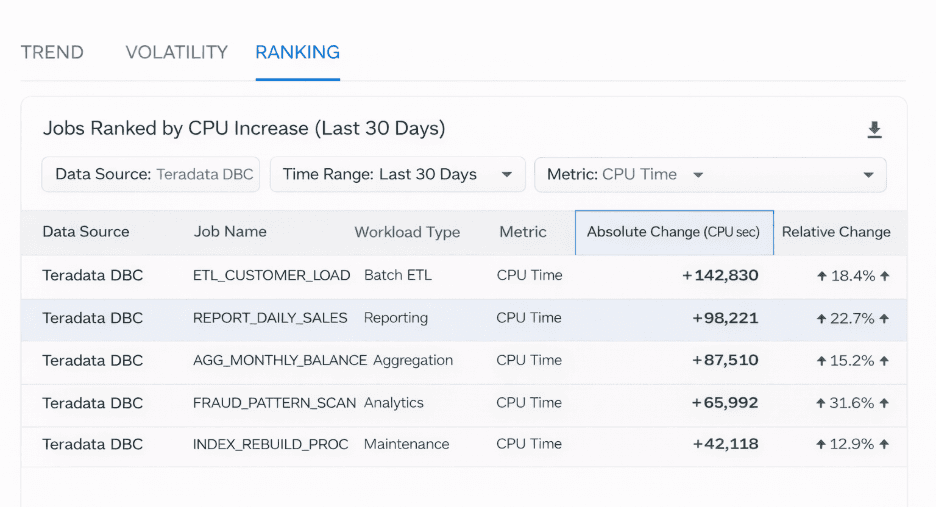

Identifier une dérive progressive

La dérive progressive est l’une des formes d’instabilité les plus coûteuses.

En classant les traitements selon :

Une augmentation absolue du CPU

Une évolution relative dans le temps

les équipes peuvent rapidement identifier les charges de travail qui contribuent le plus à l’augmentation de la charge du système.

Cela permet une optimisation ciblée plutôt que des exercices de réglage généraux.

Liste des traitements classés par augmentation mensuelle du CPU.

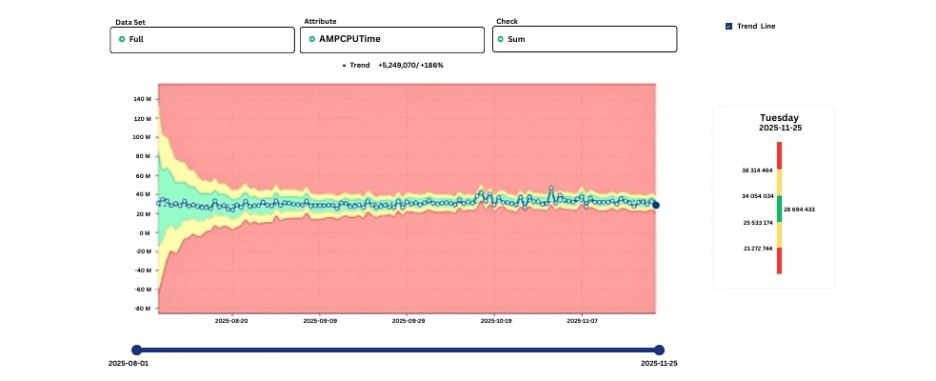

Mesurer la volatilité

La stabilité ne concerne pas seulement les moyennes.

Les traitements dont la consommation de CPU ou d’IO est très variable sont plus difficiles à planifier et risquent davantage de provoquer des problèmes en aval. La mesure de la volatilité met en évidence les charges de travail qui se comportent de manière imprévisible, même lorsque leur consommation moyenne semble acceptable.

Prendre en compte la saisonnalité

Une détection efficace tient compte des cycles connus.

En apprenant les schémas hebdomadaires et mensuels, les systèmes évitent les faux positifs tout en restant sensibles aux écarts qui rompent le comportement établi.

Tendance CPU tenant compte de la saisonnalité montrant les pics attendus de fin de mois.

Où digna s’inscrit dans l’analyse des charges de travail Teradata

Certaines approches de surveillance reposent sur l’exportation des métriques vers des systèmes externes pour analyse. D’autres fonctionnent directement dans l’environnement de la base de données.

digna lit les tables système Teradata (DBC) tout en permettant aux clients de définir comment elle accède à ces sources de métadonnées, puis convertit les métriques de charge de travail en données de séries temporelles. À l’aide de modèles basés sur l’IA, elle apprend le comportement normal et détecte les écarts statistiquement improbables, qu’il s’agisse de pics soudains ou d’une dérive lente.

Parce que digna se concentre sur le comportement plutôt que sur des seuils statiques, elle aide les équipes à détecter l’instabilité tôt, avant qu’elle ne dégénère en problèmes de performance ou de coûts.

Un aperçu de cette approche axée sur les anomalies est disponible ici ou vous pouvez réserver une démonstration avec eux.

Avantages opérationnels de la détection précoce

Les organisations qui détectent tôt l’instabilité des charges de travail Teradata constatent des avantages mesurables :

Réduction de la consommation CPU et E/S grâce à une optimisation en temps voulu

Meilleure prévisibilité des coûts

Moins de réunions d’escalade

Meilleure collaboration entre les équipes plateforme et métier

Plus grande confiance dans les résultats analytiques

Surtout, la stabilité devient gérable plutôt que réactive.

Perspectives : la stabilité comme discipline opérationnelle

Alors que Teradata continue de prendre en charge des charges de travail d’analyse et d’IA critiques pour l’entreprise, la stabilité devient une préoccupation stratégique.

La dérive silencieuse des charges de travail mine la confiance, augmente les coûts et accroît le risque opérationnel. Détecter l’instabilité tôt nécessite :

Analyse de séries temporelles

Apprentissage comportemental

Alertes tenant compte du contexte

Surcharge opérationnelle minimale

En ce sens, la stabilité des charges de travail n’est plus seulement une métrique de performance, c’est un élément central de la fiabilité des données de l’entreprise.

Réflexions finales

Les charges de travail Teradata ne deviennent pas instables du jour au lendemain. L’instabilité émerge progressivement, sous l’effet de la croissance des données, des changements de logique et de l’évolution des conditions du système.

Les équipes qui s’appuient uniquement sur une surveillance statique détectent les problèmes trop tard. Celles qui analysent le comportement des charges de travail dans le temps peuvent intervenir tôt, préservant à la fois les performances et la prévisibilité.

À mesure que les environnements Teradata continuent d’évoluer, la détection précoce de l’instabilité des charges de travail définira la maturité opérationnelle.